Changer une seule variable peut parfois faire chuter la performance d’une campagne, alors que modifier deux paramètres simultanément peut l’améliorer nettement. Un test qui fonctionne sur un site ne garantit pas les mêmes résultats ailleurs, même avec un public identique.Les erreurs de segmentation ou d’interprétation faussent fréquemment les résultats. Pourtant, la rigueur méthodologique et l’ajustement précis des paramètres transforment ces expériences en leviers d’optimisation décisifs.

L’A/B testing : un levier incontournable pour améliorer vos performances

Impossible de passer à côté : le A/B testing s’impose aujourd’hui comme la méthode de référence pour perfectionner l’expérience utilisateur et améliorer la performance de tout site web ou application mobile. Ce n’est pas simplement une question d’opposer deux versions d’une page. L’enjeu réel ? Décomposer chaque paramètre, mesurer précisément son impact, puis ajuster la stratégie pour coller au plus près de la réalité du terrain. À la clé, un taux de conversion qui décolle et des décisions UX prises sur des bases solides, bien loin des paris à l’aveugle.

Lire également : Réussir sa campagne d'email marketing avec des stratégies vraiment efficaces

Le champ des possibles est vaste : test multivarié (MVT) pour modifier simultanément plusieurs éléments, split testing pour confronter des URLs distinctes, test A/A pour vérifier la fiabilité de l’outil, ou encore test multi-pages lorsqu’une série de pages évolue en bloc. L’arsenal technique s’adapte à chaque situation, offrant une analyse de plus en plus fine.

Mais tout part d’une observation attentive du comportement des visiteurs. Cibler les audiences, c’est offrir à chaque utilisateur un parcours plus pertinent. Ce niveau de personnalisation permet d’identifier de véritables pistes d’optimisation, adaptées à chaque segment. Concrètement, cela peut donner lieu à des ajustements comme :

A lire aussi : Chatbots : qui les utilise vraiment ? Avantages et utilisations

- mettre en avant un bouton d’action pour capter l’attention des nouveaux venus,

- optimiser le panier pour encourager les habitués à ajouter plus de produits,

- ou déployer des adaptations spécifiques selon le profil utilisateur.

La technique seule ne suffit jamais. Les géants tels que Netflix, Amazon ou Google multiplient les tests, s’appuyant sur la robustesse de la donnée plutôt que sur des intuitions. D’autres suivent cet exemple, à l’image de Distingo Bank : après vingt campagnes menées avec méthode, le taux de conversion grimpe de 67 %. Lorsqu’une équipe adopte cette logique, l’optimisation devient une seconde nature.

Quels sont les principes clés pour concevoir un test A/B fiable et pertinent ?

Lancer un test A/B sans préparation donne rarement des résultats exploitables. Tout repose sur une démarche structurée. D’abord, une hypothèse claire, issue d’une observation concrète : on analyse, on cible, puis on mesure les effets de chaque modification. Pour isoler le vrai impact, une seule variable doit évoluer à la fois. C’est le seul moyen d’avoir un verdict net.

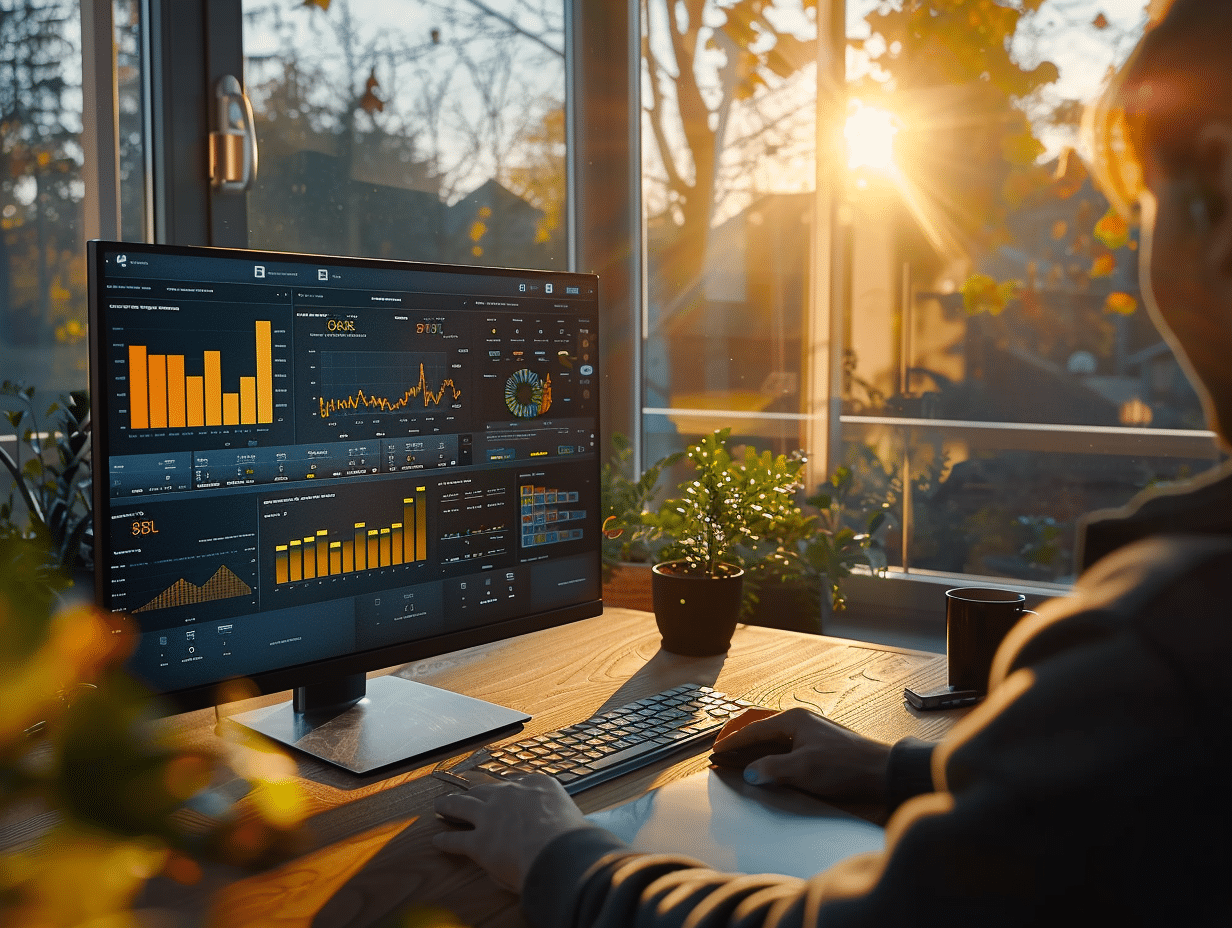

Avant de commencer, il faut déterminer ses KPI : conversions, taux de rebond, clics, panier moyen… Les décisions se fondent sur ces données tangibles. Sans repères, les résultats deviennent impossibles à interpréter ou à hiérarchiser.

La segmentation des visiteurs apporte une vision d’une précision redoutable. Différencier nouveaux visiteurs et clients fidèles, ou distinguer les acheteurs impulsifs des hésitants, permet de révéler des tendances insoupçonnées. À l’inverse, une vue globale noie les signaux et empêche de détecter les subtilités.

Il faut savoir attendre : seule une quantité de données suffisante garantit une significativité statistique, souvent fixée à 95 %. La précipitation est l’ennemi de la fiabilité.

La discipline va jusqu’à la documentation : chaque expérimentation doit être consignée, avec la variante testée, la période, les résultats et les enseignements tirés. Ce suivi méthodique nourrit une optimisation continue et prévient les erreurs répétées.

Étapes essentielles et conseils pratiques pour réussir votre A/B testing

Transformer un site ou une application passe par le A/B testing. Avant de démarrer, il faut cibler les étapes du parcours où l’impact peut être réel. Voici les zones à investiguer en priorité :

- la page d’accueil,

- les fiches produit,

- le tunnel de commande,

- les formulaires, ou l’objet d’un message marketing.

Chaque test doit découler d’une hypothèse argumentée, basée sur une analyse du comportement utilisateur.

Selon le contexte, il existe plusieurs approches :

- le test A/B classique pour comparer deux variantes,

- le test multivarié (MVT) pour jouer sur plusieurs éléments simultanément,

- ou le split testing pour mettre en regard des pages très différentes.

Certains choisissent de commencer par un test A/A, histoire de vérifier que la répartition des groupes est bien aléatoire.

La rigueur s’impose : une seule variable à la fois, un volume de données suffisant. Chaque résultat demande une interprétation attentive. Les plateformes spécialisées permettent de tout piloter, de la configuration à l’analyse finale.

Pour affiner la démarche, la segmentation de l’audience s’avère précieuse :

- un changement peut séduire les nouveaux venus mais dérouter les clients de longue date,

- il est alors pertinent de surveiller les taux de transformation, les clics ou le panier selon le profil et la page.

Des entreprises comme Distingo Bank ou 1001 Hobbies démontrent que l’optimisation structurée porte ses fruits. Les résultats ne se limitent pas à des impressions : ils s’expriment clairement dans les chiffres.

Le suivi ne doit jamais être négligé. Centraliser chaque hypothèse, noter les résultats, tirer des conclusions, ce processus construit peu à peu un véritable capital d’expérience, propice à un apprentissage permanent et à une efficacité renforcée.

Des outils adaptés et un accompagnement sur-mesure pour aller plus loin

Pour un A/B testing efficace, il faut choisir des outils à la hauteur de ses ambitions. Plusieurs plateformes permettent de gérer, segmenter, analyser en temps réel et relier les résultats à un CRM ou un outil de reporting. L’offre s’est étoffée, couvrant aussi bien les besoins courants que les cas les plus techniques.

Les acteurs majeurs comme Netflix, Amazon ou Google pilotent des milliers d’expériences en continu pour optimiser chaque détail. Les équipes plus modestes peuvent elles aussi progresser en s’appuyant sur des spécialistes capables de les guider. Un exemple : un cabinet expert accompagne une banque en ligne, réalise une vingtaine de tests structurés et observe une progression rapide du taux de conversion.

Pourtant, l’outil seul ne fait pas tout. Ce sont la méthode, la capacité à itérer, à documenter, qui font véritablement la différence. Quelques exemples à suivre : une marque déplace sa barre de recherche pour simplifier le parcours, une autre améliore la visibilité de ses appels à l’action dans le panier, une troisième épure son menu, et l’augmentation des conversions se fait sentir, parfois jusqu’à 46 %.

Le marché propose un vaste choix d’outils, chacun adapté à un usage précis. Pour clarifier :

- Solutions A/B testing polyvalentes : pour tester de multiples variantes ou mener du split testing

- Outils d’emailing : pour ajuster l’objet d’un message et maximiser le taux d’ouverture

- Plateforme d’analyse globale : afin de combiner A/B testing et analyse comportementale avancée

Que l’on soit un pure player ou une banque en ligne, les moyens d’expérimenter sérieusement sont à portée de main. L’enjeu n’est pas uniquement technique : c’est la volonté d’instaurer une démarche rigoureuse et évolutive qui permet d’avancer concrètement, test après test, vers une performance durable.